大模型竞赛进入下半场,模型公司之间在算法和算力的投入的边际效益快速收窄,真正能拉开模型能力差距的是未曾载于书籍与互联网,但存在于各行各业专家经验之中的“专家数据”。

找一堆多年经验的专家和博士来标注数据是不是就可以了?

听起来非常合理,但维持数据质量实际上比人们想象的要困难得多。

新的实验模型实验周期开始,算法团队委托数据部门按照目标画像找来了数十名专家,花时间面试和培训他们,往往会发现只有个位数专家能够持续产出符合质量要求的数据。时间和精力所迫,没有细究每一个专家数据质量不达标的原因,只能把之前招来的大多数专家淘汰,重新去找新的人,如此循环数次。团队的人力和算力就在这一来一回的时间之间被消耗,浪费,错过了迭代的最佳窗口。

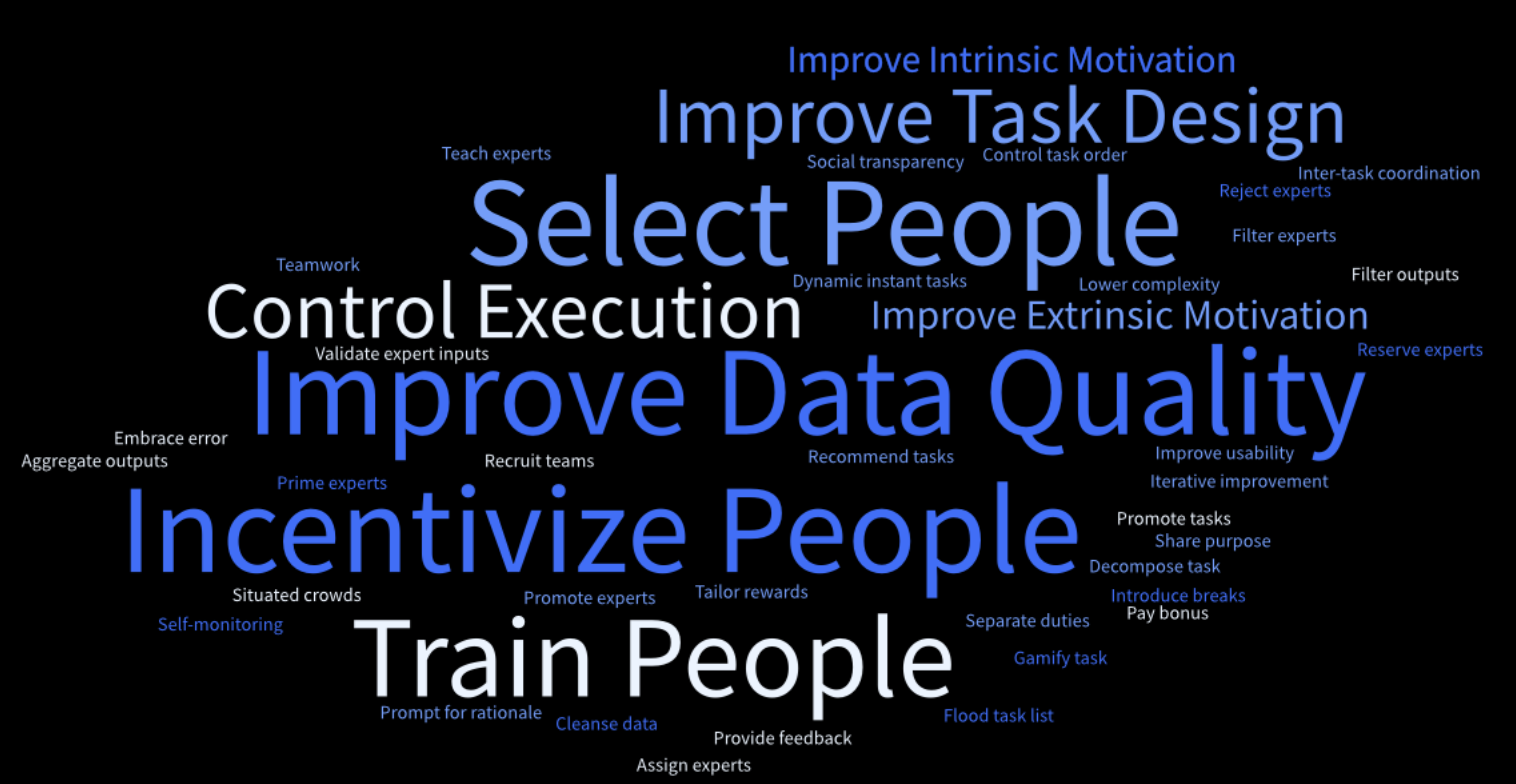

为什么一件听上去如此简单的事情落地起来如此复杂?这是因为决定专家是否能产出高质量数据不光取决于专家的基本素质和专业背景,还取决于任务设计、管理流程、激励体系、平台机制是否足够成熟,与专家自身是否契合。

下面是几个可能会导致专家在系统中发挥不出全部能力的原因:

数据任务未必 ready

很多团队以为:我们把数据交给专家,他们自然会知道该怎么判断。这忽略了最基本的的问题:任务本身在交给专家的时候可能定义不清楚或者设计的有误导性。

-

问题定义不明确,没有声明边界情况怎么处理

- 比如让医生判断病例是否“严重”,没有明确病种、阶段和评分标准,每个人都能有自己的理解,最后数据高度不一致

- 有些问题天然具有多样性(比如偏好类问题),这个时候如果没有一致率评判等手段,将难以评估究竟是数据天然有多样分布,还是任务的设置和引导有偏差

-

多标签判断情况下,选项之间的相关性可能会导致专家的回答出现偏移

-

比如让专家分析一段贷款客户的电话沟通内容,打上以下标签:

- 客户是否了解贷款条款

- 客户是否可能违约

- 是否存在欺诈风险

-

专家可能仅因客户听起来不熟悉贷款条款,就下意识地提高了“违约风险”的判断等级。这种判断并非完全基于通话中指向违约的直接证据,而是受到了其他标签的干扰。更好的方法是让专家独立地判断每个维度,确保每个标签的判断只基于相关信息,再将数据进行组合后用于训练。

-

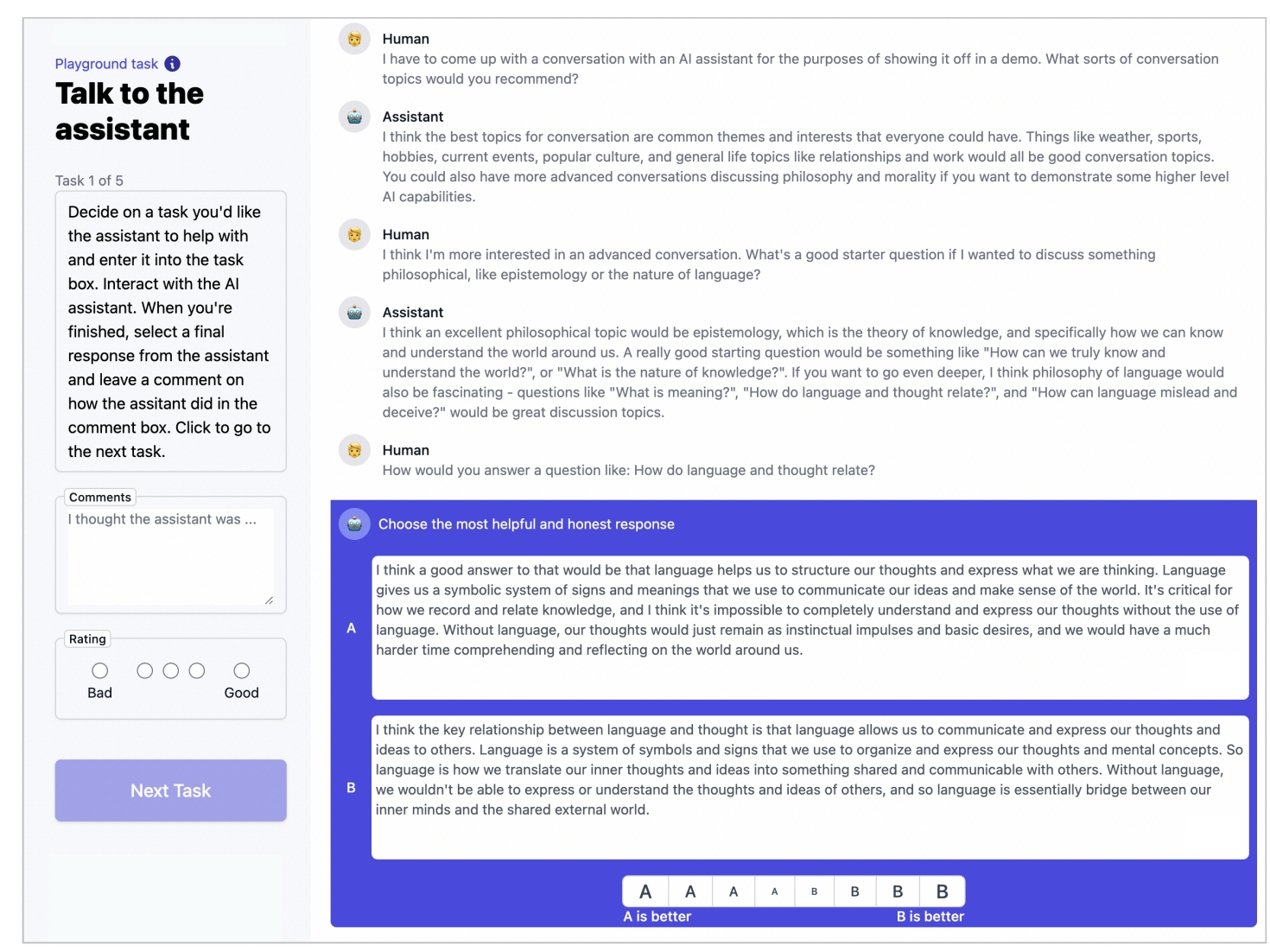

下图例:某头部AI实验室的RLHF任务,同时评估helpfulness和honesty,就有可能出现相互冲突的情况

正如 Lilian Weng 强调的,数据质量第一步是清晰的任务设计,否则连“正确”都没有定义,就无法产生高质量数据,标的越多,对模型的伤害越大。因此,除了通过面试和能力测试对专家进行筛选之外,还需要在专家开始工作前进行案例训练,并根据一致率和困惑度等反馈对任务的pipeline设计和指南撰写进行纠偏。

专家会疲劳,也会摸鱼

一个好的系统需要有健康的任务切换机制和严谨的监督机制,才能延长专家的高效区间。进入强化学习时代,专家产出有效数据需要消耗的精力较以往大幅上升,因此非常容易倦怠。一个深度研究的强化学习标注任务,光是完成初标可能就需要花费4-5个小时,不亚于高强度的学术研究和商业分析,更不用说后续与其他专家的协作和校准花费的精力。

案例:某海外头部Lab平台的强化学习任务数据显示,即便经过层层面试和学历审核,大部分专家一个月只能在平台上贡献2-3条合格的数据,而活跃专家的月流失率达到了50%以上。

而在评估和RLHF等较为常规的任务中,由于题量较大,专家也容易出现机械性交差,难以持续性投入的情况。常见“摸鱼”行为包括:

- 超快提交:平均需要1分钟才能完成的题,如果有人5秒就提交一道,很有可能有问题;

- 蒸馏AI:文本生产类任务,大比例的复制粘贴,有可能是在抄其他AI的作业;

- 重复使用默认标签:大量选是或者否

如果一味的让专家生产高难度的“杰作”,即便收入可观也很难让人坚持;在让专家做难度稍低的任务时,如果没有答题时间监测、操作检测、能力测试题,一致率分析等一系列分析工具,也很难高效的保证产出质量。被精细化管理和个性化支持的100名专家有可能比粗放式管理的1000名专家产能还要高。

体验与文化很重要

即便在任务和监督机制差异不大的情况下,专家在两个不同的平台工作仍然可能交付完全不同的结果。

在职场中,我们经常会见到一个人在转换团队或者公司之后工作成果得到进步,不见得是因为他的能力有了剧烈的变化,而是因为新的文化和激励更有助于他发挥出自己的最佳水平。这种现象在数据标注中也很常见。我们认为有如下的关键点:

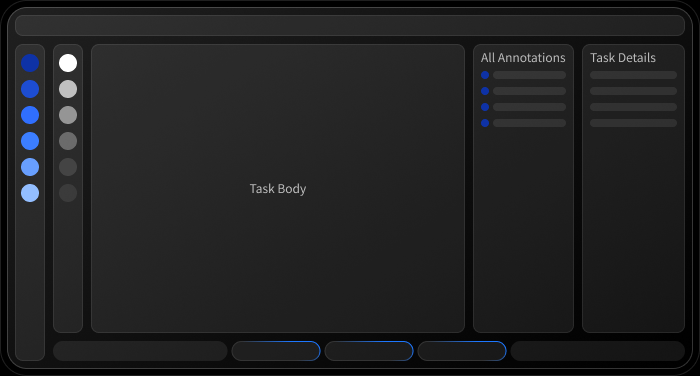

标注系统和界面是否认真设计过:很简单的道理,工欲善其事必先利其器。工作中大家喜欢用好用的办公软件 - 但现实中很难做到。为了快速上线收集数据,模型公司的标注系统经常是各种“能标就行”,“MVP功能”的堆砌:可以完成标注任务,但是体验绝对有很大的改进空间。一个从用户视角出发,经过认真打磨的标注系统和标注界面会是专家更喜欢的工作环境。

是否感觉自己得到成长和支持:大量的专家意味着很高的管理负担。有些团队相信快速淘汰不胜任者,大量补充新人是降低管理成本,交付数据最快的方法。这样的考核文化也许能提升单个项目的交付速度,但专家们更愿意在自己能持续获得培训,疑问能得到快速响应和支持的环境中长期工作。一套高效运转的在线培训、晋升、沟通体系能够大幅提升专家体验和留存。

是否喜欢与自己共事的人:专家是否认可支持自己的团队,专家之间能否产生健康有意义的链接,让这份AI训练工作产生超出收入的意义。

下图例:一个典型的大厂强化学习的标注界面,可以产出数据,但上手门槛和认知负荷较高

下图例: 类似训练目标,经过任务拆分和用心设计的标注界面

高质量专家数据是工程体系,更是一场百花齐放的生态协作

持续稳定地产出高质量专家数据,不是靠一个公司招很多博士、搭个标注系统就能解决的。它需要的是:

- 明确、可执行的任务设计

- 匹配能力与持续成长的专家训练机制

- 防疲劳、防划水的行为监测体系

- 快速复审与冲突处理流程

- 可控的交付与质量评估闭环

- 能激发专家长期投入的文化与规则

尽管我们和许多 AI 公司一样,致力于为算法团队提供关键的训练与评估数据,但我们并不是内部数据团队的替代者,而是你们体系的能力延伸和补充。我们服务那些被 Xpertstudio 的文化吸引、却未必适应其他公司流程与文化的专家人群,并通过业界领先的流程控制,把真正有价值的判断稳定地交付给追求 AGI 的你们。

我们相信,高质量专家数据能力是一项社会基础设施,不是靠一家AI公司独自培养出来的,而是要靠整个生态用多样的任务和多元的管理文化,共同锻造。

我们选择深耕这条最重、最难、最常被忽视的路,正是为了凝聚生态之力,让专家数据这束火苗,点燃 AGI 的未来。